Недавно разработчики из Google DeepMind заявили, что создали систему искусственного интеллекта, способную опередить человека в проверке достоверности фактов. Насчет этого можно сказать, что скоро искусственный интеллект будет не только умнее нас, но и начнет выявлять наши просчеты и ошибки, словно мелкая детализация.

Недавно разработчики из Google DeepMind заявили, что создали систему искусственного интеллекта, способную опередить человека в проверке достоверности фактов. Насчет этого можно сказать, что скоро искусственный интеллект будет не только умнее нас, но и начнет выявлять наши просчеты и ошибки, словно мелкая детализация.

Ведь такая система может быть полезна в самых разных сферах, от научных исследований до бизнеса, что многих напугает — вдруг все наши сомнительные манипуляции и уловки станут видны как на ладони?

Давайте представим, что такую систему применили в обычной жизни. Например, вы спорите с другом о том, кто из вас прав в каком-то вопросе. Вы вспоминаете: «А, вот, у меня же SAFE есть!» Открываете приложение на телефоне, вводите данные, и вуаля — на экране высвечивается результат: «Ваш собеседник прав — факты на его стороне.» Ну, так ведь уже неинтересно спорить! Все, веселые дискуссии и споры о поисках истины пришли к концу, настало время просто принимать истину, которую выдает вам штучка от Google.

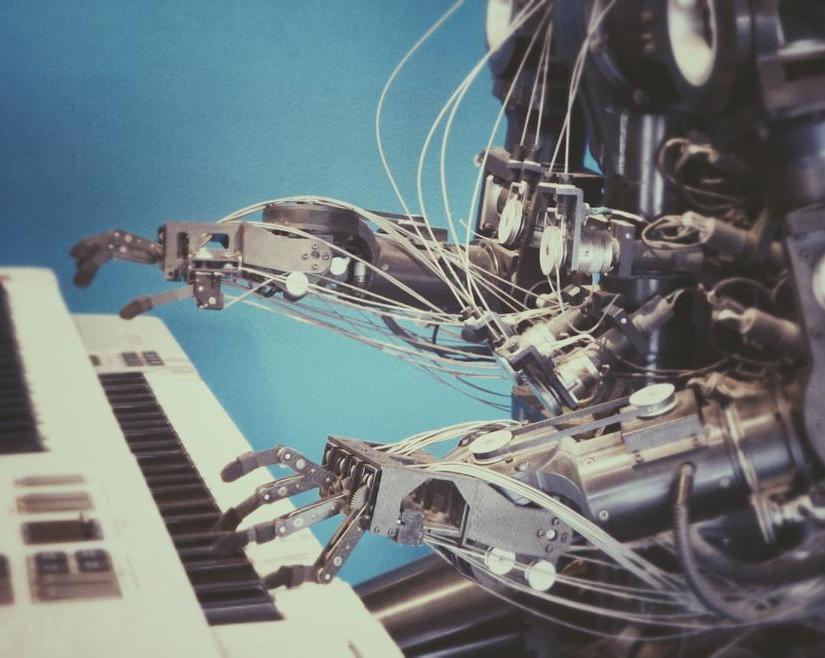

Для любителей смотреть фильмы вроде «Терминатора» и «Матрицы» это картинка с бурно мигающими надписями в духе «факт неточный» или «источник недостоверен» выглядит как апокалипсис и развал целой реальности.

Действительно, если каждый раз, когда вы делаете что-то многозначительное, вам моментально сообщают о критических ошибках, это несколько убивает романтику самовыражения и творчества.

Также интересно, что если SAFE начнет использовать результаты поиска Google для анализа информации, это значит, что все зависит от того, насколько хорошо мы представили себя в интернете. Ведь если данные о нас недостоверны или искажены, система сможет в одно мгновение проанализировать все наши «достоверные» факты и выдать нам суровую правду о том, как на самом деле обстоят дела.

Конечно, можно подумать о плюсах новой системы. Например, в медицине она сможет помочь в быстрой диагностике и принятии решений на основе проверенных данных. Только представьте, вам становится плохо, и врач, вместо того чтобы гадать на кофейной гуще, вводит в SAFE все ваши анализы и моментально видит диагноз.

Вот это да, скорая помощь искусственного интеллекта сделает чудеса!

Правда, это же применимо и к образованию. Учитель, вместо того чтобы проверять контрольную, просто сканирует ее через систему, и ученику сразу же показывается результат с подробным анализом ошибок. Здесь, конечно, есть и минусы: к чему учиться, если все ответы можно найти в интернете и получить оценку за копирование?

Однако, самое интересное, когда мы начинаем думать о том, что искусственный интеллект будет превосходить человека в проверке достоверности информации, возникает вопрос: а сможет ли он понять человеческое чувство юмора? Ведь мы так часто оперируем шутками, двусмысленностями и сарказмом, что даже для другого человека не всегда понятно, когда мы серьезны, а когда делаем шутку.

Интересно представить сценарий, где искусственный интеллект пытается анализировать юмористические тексты или анекдоты.

На экране можно увидеть сообщение: «Достоверность факта: сомнительна. Смехология не соответствует стандартам.» То есть, почти как при подаче шуток в компании — в ответ выслушиваем мертвое молчание, потому что никто не понял и не оценил наш уморительный талант.

Но в серьезной части разговора, конечно, технологии и искусственный интеллект действительно играют все более важную роль в нашей жизни. Улучшение качества анализа информации, правильные решения на основе достоверных данных — это действительно важные аспекты. И, как ни круто об этом шутить, нельзя отрицать, что развитие технологий и прогресс в сфере исследований и разработок открывает перед нами множество новых возможностей и перспектив.